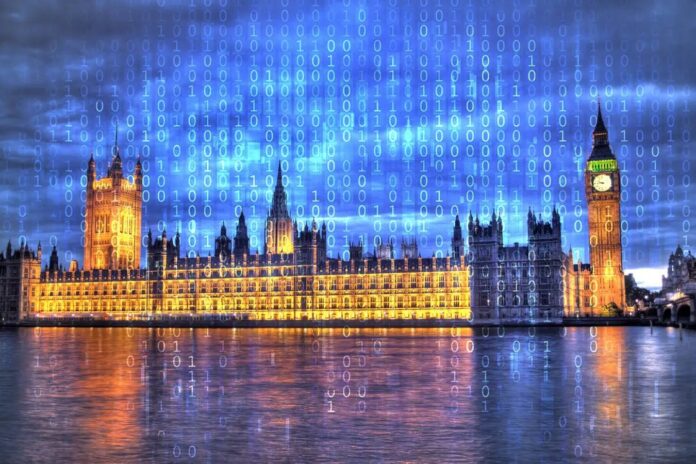

Het Information Commissioner’s Office (ICO), de Britse gegevensbeschermingsautoriteit, heeft nieuwe richtlijnen uitgegeven waarin wordt bevestigd dat interacties met kunstmatige inlichtingen door overheidspersoneel onderworpen zijn aan de wetten op de vrijheid van informatie (FOI). Deze uitspraak verduidelijkt dat zowel de aanwijzingen die door ambtenaren worden ingevoerd als de resulterende tekst, afbeeldingen of gegevens die door AI-tools worden gegenereerd, openbaar moeten worden gemaakt als het publiek daarom vraagt.

Deze ontwikkeling versterkt de transparantiemaatregelen aanzienlijk, waardoor journalisten en burgers mogelijk toegang krijgen tot gegevens van ministers die platforms als ChatGPT gebruiken voor officiële taken.

Het juridische landschap verduidelijken

Overheidsinstanties hebben al enige tijd te maken met onduidelijkheid over de manier waarop informatie over informatie van toepassing is op opkomende technologieën. De nieuwe richtlijnen van de ICO verwijderen dit grijze gebied door expliciet te stellen:

“Als personeel bij een overheidsinstantie AI voor werkdoeleinden gebruikt, valt de gegenereerde informatie samen met de gebruikte aanwijzingen onder de FOIA.”

Juridische experts suggereren dat deze verduidelijking mazen in de wet zal dichten die voorheen door overheidsinstanties werden uitgebuit. Jon Baines van advocatenkantoor Mishcon de Reya merkt op dat het nu “erg moeilijk zal zijn voor overheidsinstanties om te beweren dat AI-gerelateerde verzoeken niet onder de FOIA vallen.”

De logica is eenvoudig: als informatie door een ambtenaar wordt vastgelegd tijdens de uitoefening van zijn functie, valt deze onder de FOI, ongeacht of deze op een Post-it-briefje is geschreven of door een groot taalmodel is gegenereerd. Tim Turner, een expert op het gebied van gegevensbescherming, stelt dat dit “oncontroversieel” moet zijn, en benadrukt dat het medium voor het bijhouden van gegevens de inhoud niet vrijstelt van transparantiewetten.

Impact op transparantie en toegankelijkheid

Deze leidraad zou een nieuwe vorm kunnen geven aan de manier waarop overheidstransparantie in het digitale tijdperk functioneert. Twee belangrijke implicaties vallen op:

- Toegang tot besluitvormingsprocessen : Burgers kunnen nu de specifieke aanwijzingen opvragen die door ambtenaren worden gebruikt, waardoor inzicht wordt geboden in de manier waarop AI beleidsadvies of administratieve beslissingen beïnvloedt.

- Het overwinnen van kostenbarrières : De ICO suggereert dat overheidsinstanties mogelijk AI kunnen gebruiken om grote datasets samen te vatten bij het reageren op FOI-verzoeken. Dit zou de autoriteiten in staat kunnen stellen verzoeken in te willigen die voorheen werden afgewezen vanwege de buitensporige kosten, waardoor de hoeveelheid toegankelijke informatie zou toenemen.

Precedent en controverse

De uitspraak volgt op een baanbrekende zaak vorig jaar, toen New Scientist met succes de ChatGPT-logboeken van de voormalige Britse technologiesecretaris Peter Kyle verkreeg. Aangenomen wordt dat dit de eerste keer is dat een dergelijk verzoek wereldwijd wordt ingewilligd. Latere pogingen van andere media om toegang te krijgen tot vergelijkbare gegevens werden echter vaak afgewezen, waarbij de autoriteiten verzoeken als ‘ergerlijk’ bestempelden of hoge verwerkingskosten noemden.

De nieuwe richtlijnen zijn bedoeld om dergelijke algemene weigeringen te voorkomen. De stap heeft echter tot discussie geleid over privacy en bruikbaarheid. Matt Clifford, voorzitter van het Britse Advanced Research and Invention Agency (ARIA), bekritiseerde het precedent dat door de Kyle-zaak werd geschapen en noemde het “absurd” en “enorm corrosief.” Hij waarschuwde dat een dergelijk onderzoek ministers ervan zou kunnen weerhouden om AI-instrumenten helemaal te gebruiken, waardoor innovatie in overheidsoperaties zou worden onderdrukt. Met name is ARIA zelf vrijgesteld van FOI-wetten, wat de ongelijke toepassing van transparantieregels in verschillende overheidsinstanties benadrukt.

Waarom dit belangrijk is

Het snijvlak van AI en bestuur roept kritische vragen op over verantwoording en vertrouwen. Nu overheden steeds meer afhankelijk zijn van AI voor het opstellen van communicatie, het analyseren van gegevens en het formuleren van beleid, wordt het begrijpen hoe deze instrumenten worden gebruikt essentieel voor democratisch toezicht.

Als ambtenaren AI kunnen gebruiken om officiële resultaten te genereren zonder publieke controle, ontstaat er een ‘black box’ in het bestuur. Door te bevestigen dat AI-logboeken onderworpen zijn aan FOI, zorgt de ICO ervoor dat de integratie van kunstmatige intelligentie in de publieke dienstverlening transparant blijft. Dit schept een essentieel precedent voor andere landen die worstelen met de manier waarop ze AI in de publieke sector moeten reguleren.

Conclusie

De richtlijnen van de ICO stellen een duidelijke grens vast: Het gebruik van AI binnen de overheid is geen privésfeer. Hoewel de zorgen over de afschrikwekkende effecten op de innovatie blijven bestaan, geeft de uitspraak prioriteit aan het publieke recht om te weten, om ervoor te zorgen dat de snelle adoptie van AI de democratische verantwoordingsplicht niet overtreft.